来源:CDCC

AI成为碳排放的重要来源,要减排,砸钱还是砸技术?

与2020年基线相比,微软2023年的直接排放和能源相关排放减少了6.3%。然而,其供应链排放——占总排放的绝大部分——增加了30.9%。

能源和碳排成为AI发展的约束边界

AI要依靠大量算力,这是人所共知的事实。但最近,当AI业界大佬们抛出“AI的尽头是能源/电力”这个观点时,仍然让市场大吃一惊。

AI究竟有多耗能呢?研究显示,AI大语言模型ChatGPT每天要响应用户约2亿个请求,消耗超过50万千瓦时的电力。相比之下,一个家庭平均每天用电约29千瓦时,也就是说,chatGPT每天的用电量是家庭用电量的1.7万多倍。

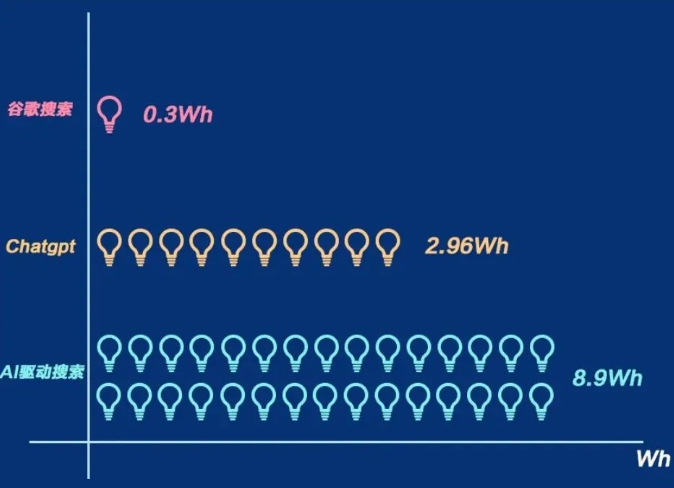

图:AI大模型使搜索引擎的耗电量激增

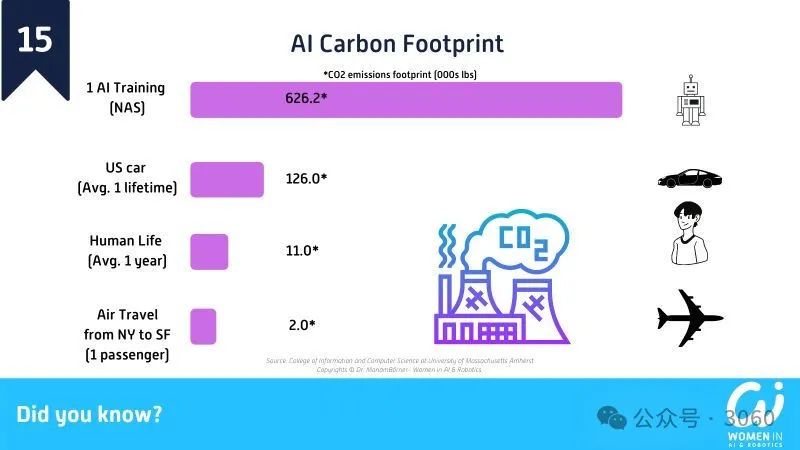

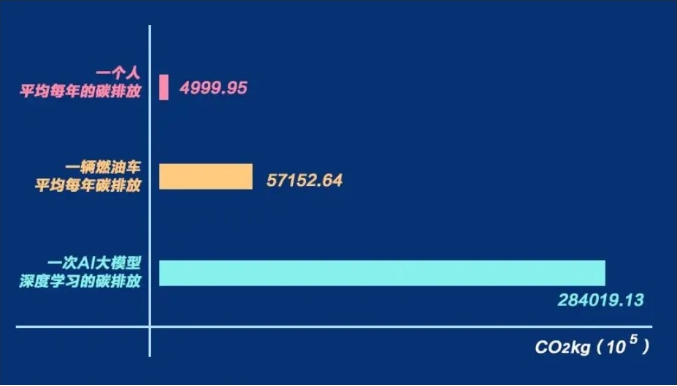

随着生成式人工智能模型变得更加复杂和要求更高,它们消耗的电量也越来越多,随之而来的就是高排放。

AI大模型,正在成为碳排放的一个重要来源。

数据来源:夏洛特·德布斯 (Charlotte Debus) 等人2023年11月10日发表在Nature上的论文《报告电力消耗对可持续A1至关重要》

尽管AI大模型是碳排放大户,但以AI为代表的前沿科技也正在为降碳减排做出贡献。

尽管AI大模型是碳排放大户,但以AI为代表的前沿科技也正在为降碳减排做出贡献。

首先是购买可再生能源电力和购买碳信用。从2010到2022年,谷歌签署了80多份协议,涉及总计约10千兆瓦的清洁能源发电量。

微软早在2012年就在购买环境权益,并提出了要在2025年企业范围内实现近零排放。微软本月更是表示,将支持由Brookfield Asset Management开发的估计价值100亿美元的可再生电力项目,作为其将清洁能源目标与AI雄心结合的努力的一部分。

除了外在的抵消,人工智能自身的减排更重要,目前有几种方法。

一种是负载转移策略,人工智能发展水平高的公司数据中心也遍布各地,谷歌通过复杂的算法识别出电网上太阳能和风能过剩的区域,然后战略性地加强这些区域的数据中心运营。甚至将某些数据中心与零碳源按小时进行匹配,力求实现全天候使用清洁能源供电。

另一种方法是绿色加速分析技术,比如英伟达新设计的一款加速数据分析软件Apache Spark可以将成本和排放量减少80%。原理是提高软件本身的计算速度,原本需要一个月处理的数据5个小时就处理完了,能耗自然就大大降低了,用这种绿色计算训练人工智能可将成本降低90%。

总之,AI技术的进步给人类带来了诸多便利,其爆发式发展必定带来用电量的剧增,但也必须在发展中关注环境问题。未来AI如何实现可持续发展,以及AI如何更好地支撑双碳领域的变革,仍是亟需各行业共同解决的问题。

特别声明:本网站转载的所有内容,均已署名来源与作者,版权归原作者所有,若有侵权,请联系我们删除。凡来源注明低碳网的内容为低碳网原创,转载需注明来源。

-

1

-

2

-

3

-

4

-

5

-

6

-

7

-

8

-

9